Gibt Google Videosuchergebnisse mit maschinellem Lernen zurück?

Veröffentlicht: 2020-04-15Probleme mit Videosuchergebnissen

Ein Bereich, der Suchenden Probleme bereitet, ist, wenn sie als Antwort auf eine Anfrage nach einem Video suchen. Ein kürzlich erteiltes Google-Patent beschreibt, wie Google auf Anfragen reagiert, die Videosuchergebnisse anzeigen. Das Patent sagt uns, dass der Zweck dahinter darin besteht, „Videos oder deren Teile zu identifizieren, die für Suchbegriffe relevant sind“.

Der dem Patent zugrunde liegende Algorithmus versucht ein Problem zu lösen, das in der Patentbeschreibung ausführlich beschrieben ist.

Es sagt uns, dass Menschen, die „Medienhosting-Websites“ verwenden, normalerweise gehostete Medieninhalte wie Videos durchsuchen oder durchsuchen, indem sie versuchen, Schlüsselwörter oder Suchbegriffe in Abfragen zu verwenden, um „textuelle Metadaten zur Beschreibung der Medieninhalte“ zu finden. Was mit „textuellen Metadaten“ gemeint ist, kann Folgendes umfassen:

- Titel von Mediendateien

- Beschreibende Zusammenfassungen der Medieninhalte

Das Patent erklärt, warum dies ein Problem sein kann. Es sagt uns, dass solche textuellen Metadaten oft nicht den gesamten Inhalt des Videos repräsentieren können, insbesondere wenn ein Video sehr lang ist und eine Vielzahl von Szenen enthält.

Normalerweise ist eine Beschreibung zu einem Video ziemlich kurz und beschreibt nicht alle Szenen in einem Video. Dies kann bedeuten, dass ein Video, nach dem ein Suchender sucht, möglicherweise nicht als Antwort auf eine Suche nach Schlüsselwörtern zurückgegeben wird, die solche Szenen beschreiben könnten. Wie das Patent uns sagt:

Daher geben herkömmliche Suchmaschinen oft nicht die für die Suche des Benutzers relevantesten Medieninhalte zurück

Ein weiteres Problem bei den meisten Medienhosting-Websites tritt aufgrund einer großen Menge gehosteter Medieninhalte auf. Eine Suchanfrage kann Hunderte oder sogar Tausende von Videos als Reaktion auf die Benutzeranfrage zurückgeben.

Dies kann bedeuten, dass ein Benutzer möglicherweise nicht mehr entscheiden kann, welche der Videosuchergebnisse am relevantesten sind.

Um jemandem die Entscheidung zu erleichtern, welches Video am relevantesten ist, kann eine Website diese Suchergebnisse mit Miniaturansichten anzeigen

Miniaturbilder für Videos sind oft ein vorbestimmter Frame aus der Videodatei (möglicherweise der erste Frame, der mittlere Frame oder der letzte Frame).

Dies kann ein Problem darstellen, da auf diese Weise ausgewählte Thumbnails oft nicht repräsentativ für den Inhalt des Videos sind. Und diese Miniaturansicht ist möglicherweise für die Suchanfrage eines Benutzers nicht relevant. Ist dies nicht der Fall, kann ein Nutzer möglicherweise nicht beurteilen, welches der vielen Suchergebnisse am relevantesten ist.

Aufgrund dieser Probleme mit Videosuchergebnissen versucht dieses Patent, verbesserte Verfahren zum Auffinden und Darstellen von Videosuchergebnissen bereitzustellen, die es einem Benutzer ermöglichen, die Relevanz dieser Videos leicht zu beurteilen.

Verbesserte Videosuchergebnisse

Dieser Ansatz mit Videosuchergebnissen funktioniert, um Videoergebnisse zu finden und zu präsentieren, die auf eine Keyword-Abfrage eines Benutzers reagieren. Dieses System:

- Erhält eine Keyword-Abfrage von einem Suchenden

- Wählt ein Video mit Inhalten aus, die für die Keyword-Abfrage relevant sind

- Wählt einen Frame aus dem Video, der für den Inhalt des Videos repräsentativ ist, unter Verwendung eines Videoindex, der Schlüsselwortzuordnungsbewertungen zwischen Frames mehrerer Videos und Schlüsselwörter speichert, die den Videoframes zugeordnet sind

- Der ausgewählte Frame wird als Miniaturansicht für das Video angezeigt

Wie dieses System ein maschinell gelerntes Modell verwendet, um Videosuchergebnisse zurückzugeben

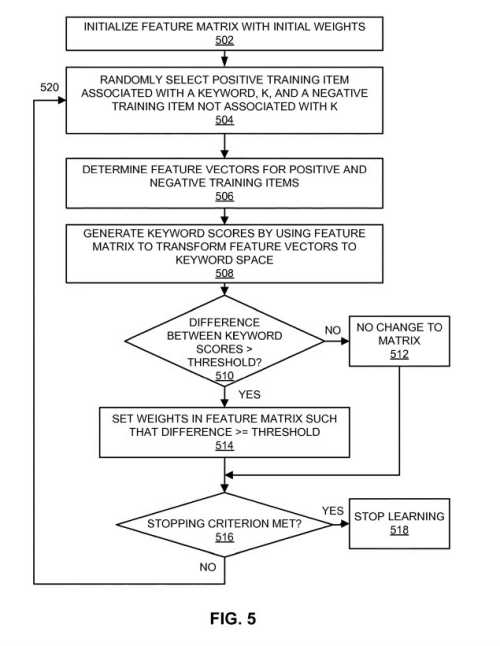

Dieses System tut dies durch:

- Erstellen eines durchsuchbaren Videoindex mit einem maschinell gelernten Modell der Beziehungen zwischen Merkmalen von Videoframes und Schlüsselwörtern, die den Videoinhalt beschreiben

- Empfangen eines gekennzeichneten Trainingsdatensatzes, der eine Reihe von Medienelementen (z. B. Bilder oder Audioclips) zusammen mit einem oder mehreren Schlüsselwörtern enthält, die den Inhalt dieser Medienelemente beschreiben

- Extrahieren von Merkmalen, die den Inhalt der Medienelemente charakterisieren

- Erlernen von Zusammenhängen zwischen bestimmten Merkmalen und den den Inhalt beschreibenden Schlüsselwörtern

- Erstellen eines Videoindex, der Frames von Videos in einer Videodatenbank Schlagwörtern zuordnet, basierend auf den Merkmalen der Videos und dem maschinell gelernten Modell

Das Patent sagt uns, dass der Vorteil der Verwendung des Verfahrens aus diesem Patent darin besteht, dass dieses Video-Hosting-System Suchergebnisse basierend auf dem tatsächlichen Inhalt der Videos findet und präsentiert, anstatt sich ausschließlich auf textliche Metadaten in der Nähe von Videos zu verlassen. Es ermöglicht einem Suchenden, die Relevanz von Videos aus den Suchergebnissen besser einzuschätzen.

Dieses Patent für Videosuchergebnisse finden Sie unter:

Relevanzbasierte Bildauswahl

Erfinder: Gal Chechik und Samy Bengio

Rechtsnachfolger: Google LLC

US-Patent: 10.614.124

Bewilligt: 7. April 2020

Gespeichert: 15. April 2015

Abstrakt

Ein System, ein computerlesbares Speichermedium und ein computerimplementiertes Verfahren präsentieren Videosuchergebnisse als Reaktion auf eine Benutzer-Schlüsselwortabfrage. Das Video-Hosting-System verwendet einen maschinellen Lernprozess, um ein Merkmal-Schlüsselwort-Modell zu lernen, das Merkmale von Medieninhalten aus einem gekennzeichneten Trainingsdatensatz mit Schlüsselwörtern verknüpft, die ihren Inhalt beschreiben. Das System verwendet das gelernte Modell, um basierend auf den in den Videos gefundenen Funktionen Videosuchergebnisse bereitzustellen, die für eine Schlüsselwortabfrage relevant sind. Darüber hinaus bestimmt und präsentiert das System ein oder mehrere Miniaturbilder, die für das Video repräsentativ sind, unter Verwendung des gelernten Modells

Ergebnisse der Videosuche zum Mitnehmen

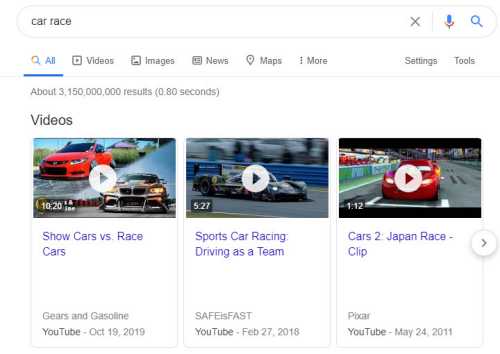

Wenn Google diesen Ansatz verwendet, achtet es auf alle Szenen in einem Video. Selbst ein langes Video mit einer Autorennen-Szene kann in den Metadaten, die das Video begleiten, nicht beschrieben werden. Das Patent sagt uns Folgendes:

Wenn der Benutzer beispielsweise die Suchanfrage „Autorennen“ eingibt, kann die Videosuchmaschine eine Autorennenszene aus einem Film finden und zurückgeben, auch wenn die Szene möglicherweise nur ein kurzer Teil des Films ist, der nicht in der Beschreibung beschrieben ist textuelle Metadaten.

Der in diesem Patent beschriebene Prozess würde von niemandem verlangen, etwas Besonderes oder Anderes zu tun. Es würde nur bedeuten, dass Google Videos besser zurückgeben könnte, die Inhalte enthalten könnten, nach denen ein Suchender möglicherweise sucht, wie beispielsweise eine Autorennenszene aus einem Film.

Zu diesem Zweck kann eine Videosuchmaschine ein Miniaturbild oder einen Satz von Miniaturbildern auswählen, die mit jedem abgerufenen Suchergebnis angezeigt werden.

Dieses Miniaturbild kann ein Bildrahmen sein, der für den audiovisuellen Inhalt des Videos repräsentativ ist und auch auf eine Suchanfrage eines Suchers reagiert. Es kann einem Suchenden helfen, die Relevanz des Suchergebnisses zu bestimmen.

Eine Videoanmerkungsmaschine kann Frames oder Szenen eines Videos aus einer Videodatenbank mit Schlüsselwörtern kommentieren, die für den audiovisuellen Inhalt der Frames oder Szenen relevant sind, und speichert diese Anmerkungen im Videoannotationsindex. Das ist, was gesucht wird, wenn ein Suchender nach einem Ergebnis sucht.

Das Patent liefert viel mehr Details darüber, wie Inhalt eines Videos basierend auf Schlüsselwörtern indiziert werden könnte, die verwendet werden könnten, um Frames aus dem Video mit Anmerkungen zu versehen.

Dieser Vorgang kann dazu führen, dass für Suchanfragen des Suchers relevantere Videos auf Grundlage des tatsächlichen Inhalts dieser Videos zurückgegeben werden als nur textuelle Metadaten, die ein Video begleiten.

Wenn Sie Videos an Websites wie YouTube senden, können Sie die Google-Suche testen, um zu sehen, ob diese Videos basierend auf mehr als nur den Metadaten zu diesen Videos zurückgegeben werden