Malgré tout, Facebook reste un facilitateur de premier plan de la désinformation électorale

Publié: 2022-04-08Au cours des quatre dernières années, Facebook a mis en œuvre une série de mesures pour éradiquer la désinformation, lutter contre l'ingérence électorale et s'assurer que ses utilisateurs sont tenus informés avec précision, malgré les divers efforts déployés par divers groupes pour utiliser le vaste réseau de l'entreprise afin d'influencer le public. l'opinion et influencer les résultats des élections en leur faveur.

La poussée accrue de Facebook est intervenue après les révélations de diverses opérations de désinformation et d'influence de masse pendant la campagne électorale américaine de 2016, qui comprenait le scandale très médiatisé de Cambridge Analytica, et les révélations de l'Agence de recherche Internet russe diffusant des milliers de publicités pour susciter la division parmi les électeurs américains. Il est impossible de dire quelle était l'efficacité réelle de l'une ou l'autre de ces poussées, mais les deux se sont produites, et vous imagineriez qu'elles ont eu au moins un certain effet.

Les diverses mesures de Facebook semblent avoir annulé une grande partie de l'influence et de la manipulation étrangères qui étaient présentes en 2016 - pourtant, malgré cela, plusieurs nouvelles informations montrent que Facebook facilite toujours la propagation de la désinformation, avec les allégations de fraude électorale du président Donald Trump, en particulier , qui gagne en popularité via The Social Network.

La semaine dernière, Facebook a publié un article dans lequel il cherchait à réfuter les affirmations selon lesquelles son algorithme amplifie de manière disproportionnée le contenu controversé de droite, ce qui suscite l'engagement et l'interaction, et donc, apparemment, gagne en portée.

Facebook a publié le message en réponse à ces listes, publiées quotidiennement par l'écrivain du New York Times Kevin Roose.

Les publications de liens les plus performantes des pages Facebook américaines au cours des dernières 24 heures proviennent de :

– Top 10 de Facebook (@FacebooksTop10) 17 novembre 2020

1.Dan Bongino

2. RENARD 29

3. Donald J. Trump

4. Donald J. Trump

5. Nouvelles de Fox

6. Dan Bongino

7. CNN

8. Dios Es Bueno

9. Breit Bart

10. Nouvelles de Fox

Les listes, qui sont basées sur des données d'engagement accessibles via la propre plate-forme d'analyse de Facebook CrowdTangle, semblent montrer que le contenu des éditeurs d'extrême droite fonctionne mieux sur Facebook, ce qui signifie souvent que des informations douteuses, sinon manifestement fausses, ont une grande portée et engagement à travers le réseau social.

Mais attendez, Facebook a dit, ce n'est pas toute l'histoire :

" La plupart des contenus que les gens voient [sur Facebook], même en période électorale, ne concernent pas la politique. En fait, d'après notre analyse, le contenu politique représente environ 6 % de ce que vous voyez sur Facebook. Cela inclut les messages d'amis. ou à partir de pages (qui sont des profils publics créés par des entreprises, des marques, des célébrités, des médias, des causes, etc.)."

Ainsi, alors que les chiffres publiés par Roose peuvent montrer que le contenu des nouvelles de droite suscite beaucoup d'engagement, ce n'est qu'une fraction de ce que les utilisateurs voient dans l'ensemble.

« Le classement des publications en tête de page par réactions, commentaires, etc. ne donne pas une image complète de ce que les gens voient réellement sur Facebook. »

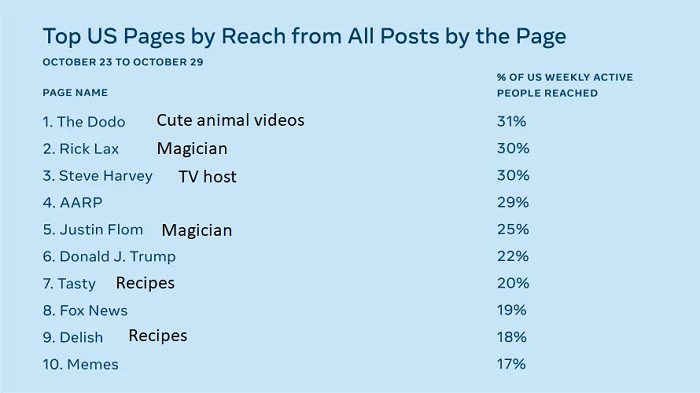

Pour le démontrer, Facebook a partagé cette liste du contenu qui obtient le plus de portée sur Facebook - c'est-à-dire que les publications de ces pages sont apparues dans le fil d'actualité le plus utilisé pour la semaine en question :

J'ai ajouté les descriptions en texte noir pour le contexte. Comme vous pouvez le voir, la plupart du contenu que les gens voient n'est pas basé sur la politique, ce qui, selon Facebook, montre que les mises à jour politiques ne sont pas aussi répandues que les listes de Roose le suggèrent.

Mais encore une fois, cette liste prouve en quelque sorte le point de vue de Roose - parmi les 10 meilleures pages de la semaine ci-dessus, en fonction de la portée des utilisateurs actifs américains, les deux pages politiques les plus présentes sont :

- Donald J.Trump

- Fox News

Ainsi, bien que les gens voient beaucoup d'autres contenus, vous pouvez également affirmer que les vidéos de recettes n'influenceront probablement pas la façon dont les gens votent. Ce qui suggérerait que Facebook, même par sa propre explication, contribue à stimuler des opinions politiques plus extrêmes.

Et cela mène ensuite à la préoccupation suivante.

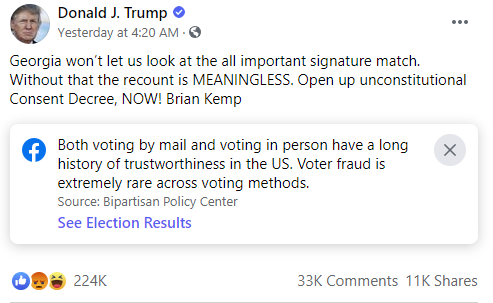

Cette semaine, BuzzFeed News a rapporté que malgré l'ajout par Facebook d'étiquettes d'avertissement aux messages de Trump qui ont critiqué l'élection américaine et suggéré une fraude généralisée dans le processus de vote, ces étiquettes ont eu peu d'impact sur le partage social.

BuzzFeed a partagé cette citation d'un forum de discussion interne sur Facebook :

"Nous avons des preuves que l'application de ces [étiquettes] aux publications diminue leurs partages d'environ 8 %. Cependant, étant donné que Trump a TELLEMENT d'actions sur un poste donné, la diminution ne va pas changer les actions par ordre de grandeur.

Comme vous pouvez le voir, le message ci-dessus a encore été largement partagé et commenté. Mais Facebook peut aussi y contribuer directement. Comme indiqué, l'algorithme de Facebook cherche à stimuler les publications qui suscitent plus d'engagement, afin de garder les gens actifs et sur la plateforme plus longtemps. Cela signifie que les messages qui génèrent beaucoup de commentaires et de discussions ont tendance à avoir une plus grande portée.

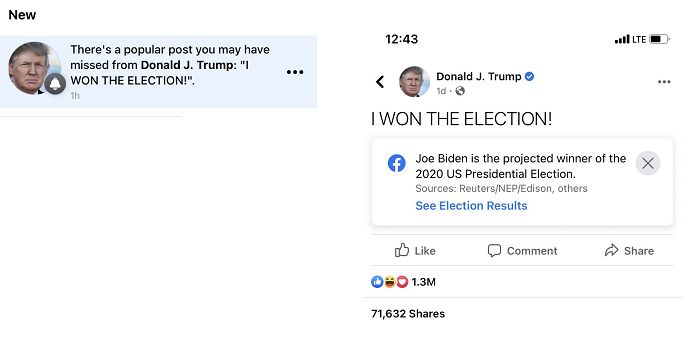

Le système de Facebook pousse même cela directement - comme le montre cet exemple partagé par Deepa Seetharaman du Wall Street Journal :

Ainsi, plutôt que de limiter la diffusion de ces affirmations, Facebook les promeut activement auprès des utilisateurs, afin de susciter l'engagement. Cela contraste considérablement avec Twitter, qui a annoncé la semaine dernière qu'il avait constaté une baisse de 29 % des tweets de citation en raison de ses propres étiquettes d'avertissement.

Les données ici montrent que non seulement Facebook ne voit aucun impact majeur à la suite de ses mesures de dissuasion, mais que ses propres systèmes, intentionnellement ou non, contrecarrent même ces efforts.

Pourquoi? Parce que, comme beaucoup l'ont noté, Facebook valorise l'engagement avant tout dans la plupart des cas. Il semble, dans ce cas, que ses mesures internes pour stimuler l'interaction puissent par inadvertance aller à l'encontre de ses autres opérations.

Alors qu'est-ce qui vient ensuite? Facebook devrait-il faire l'objet d'un examen plus minutieux et être contraint de revoir ses processus afin d'arrêter la propagation de la désinformation ?

C'est, du moins en partie, le sujet de la dernière série de la dernière audience judiciaire du Sénat sur d'éventuelles réformes des lois de l'article 230. Dans le cadre de cet examen, Facebook et Twitter ont été confrontés à des questions sur l'influence de leurs plateformes et sur la manière dont leurs systèmes incitent à l'engagement.

Ces auditions pourraient éventuellement conduire à une réforme, d'une manière ou d'une autre, et avec l'ancien président Barack Obama suggérant cette semaine que les plateformes sociales devraient être réglementées, il pourrait y avoir plus de mouvement à venir sur ce front.

Comme Obama l'a expliqué à The Atlantic :

" Je ne tiens pas les entreprises technologiques entièrement responsables [de la montée de la politique populiste], car cela est antérieur aux médias sociaux. C'était déjà là. Mais les médias sociaux l'ont accéléré. Je connais la plupart de ces gens. J'ai parlé à La mesure dans laquelle ces entreprises insistent sur le fait qu'elles ressemblent plus à une compagnie de téléphone qu'à The Atlantic , je ne pense pas qu'elle soit tenable. Elles font des choix éditoriaux, qu'elles les aient enterrés dans des algorithmes ou non. Le premier amendement n'oblige pas les entreprises privées à fournir une plate-forme pour tout point de vue qui existe.

Avec l'ancien vice-président d'Obama, Joe Biden, qui devrait prendre les rênes en janvier, nous pourrions voir un changement significatif dans l'approche de cette évolution, ce qui pourrait limiter la capacité de Facebook à faciliter ce contenu.

Mais encore une fois, même si de nouvelles règles sont promulguées, il y aura toujours des cas limites, et comme nous l'avons vu avec la montée soudaine de Parler, il y aura également des plates-formes alternatives qui répondront à des points de vue plus controversés.

Peut-être est-ce alors la conséquence d'un paysage médiatique plus ouvert - avec moins de gardiens pour limiter la propagation de la désinformation, il restera de plus en plus difficile à contenir.

Les défenseurs de la liberté d'expression salueront cela comme un avantage, tandis que d'autres n'en seront peut-être pas si sûrs. Quoi qu'il en soit, avec la discussion sur les élections de 2020 qui se poursuit, nous en verrons probablement d'autres exemples avant que les plateformes ne soient vraiment poussées à agir.