Nonostante tutto, Facebook rimane un importante facilitatore della disinformazione elettorale

Pubblicato: 2022-04-08Negli ultimi quattro anni, Facebook ha implementato una serie di misure per eliminare la disinformazione, contrastare le interferenze elettorali e garantire che i suoi utenti siano tenuti accuratamente informati, nonostante i vari sforzi, da vari gruppi, per utilizzare la massiccia rete dell'azienda al fine di influenzare il pubblico l'opinione e l'influenza elettorale risultano a proprio favore.

La maggiore spinta di Facebook è arrivata dopo le rivelazioni di varie operazioni di disinformazione e influenza di massa durante la campagna elettorale statunitense del 2016, che includeva lo scandalo di alto profilo Cambridge Analytica e le rivelazioni dell'Agenzia russa di ricerca su Internet che ha pubblicato migliaia di annunci per innescare divisioni tra gli elettori statunitensi. È impossibile dire quanto sia stata effettivamente efficace una di queste spinte, ma entrambe sono accadute e si potrebbe immaginare che abbiano almeno avuto qualche effetto.

Le varie misure di Facebook sembrano aver negato gran parte dell'influenza straniera e della manipolazione che era presente nel 2016, eppure, nonostante ciò, diverse nuove intuizioni mostrano che Facebook sta ancora facilitando la diffusione della disinformazione, con le affermazioni di frode elettorale del presidente Donald Trump, in particolare , guadagnando una maggiore trazione tramite The Social Network.

La scorsa settimana, Facebook ha pubblicato un post in cui cercava di confutare le affermazioni secondo cui il suo algoritmo amplifica in modo sproporzionato i contenuti controversi di destra, che stimolano il coinvolgimento e l'interazione e, quindi, apparentemente, guadagnano portata.

Facebook ha pubblicato il post in risposta a questi elenchi, pubblicati quotidianamente dallo scrittore del New York Times Kevin Roose.

I post con i link più performanti delle pagine Facebook statunitensi nelle ultime 24 ore provengono da:

— La Top 10 di Facebook (@FacebooksTop10) 17 novembre 2020

1. Dan Bongino

2. VOLPE 29

3. Donald J. Trump

4. Donald J. Trump

5. Notizie sulla volpe

6. Dan Bongino

7. CNN

8. Dios Es Bueno

9. Breitbart

10. Notizie sulla volpe

Gli elenchi, che si basano sui dati di coinvolgimento a cui si accede tramite la piattaforma di analisi di Facebook CrowdTangle, sembrano mostrare che i contenuti di editori di estrema destra hanno prestazioni migliori su Facebook, il che spesso significa che informazioni discutibili, se non dimostrabilmente false, stanno ottenendo grande portata e coinvolgimento attraverso il social network.

Ma aspetta, Facebook ha detto, non è tutta la storia:

" La maggior parte dei contenuti che le persone vedono [su Facebook], anche in una stagione elettorale, non riguardano la politica. Infatti, sulla base della nostra analisi, i contenuti politici costituiscono circa il 6% di ciò che si vede su Facebook. Ciò include i post degli amici o dalle Pagine (che sono profili pubblici creati da aziende, marchi, celebrità, organi di informazione, cause e simili)."

Quindi, mentre i numeri pubblicati da Roose possono mostrare che i contenuti delle notizie di destra ottengono molto coinvolgimento, questa è solo una frazione di ciò che gli utenti vedono nel complesso.

" Classificare i post in cima alla Pagina in base a reazioni, commenti, ecc. non fornisce un quadro completo di ciò che le persone vedono effettivamente su Facebook. "

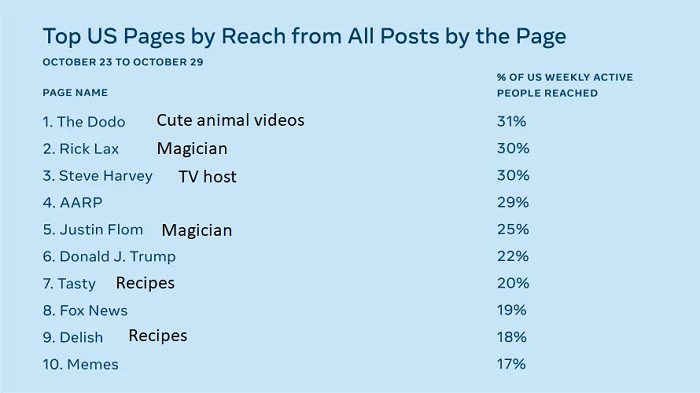

Per dimostrarlo, Facebook ha condiviso questo elenco di quali contenuti ottengono effettivamente la maggior copertura su Facebook, ovvero i post di queste pagine sono apparsi nel feed di notizie più utilizzato per la settimana in questione:

Ho aggiunto le descrizioni del testo nero per il contesto. Come puoi vedere, la maggior parte dei contenuti che le persone vedono non sono basati sulla politica, il che, afferma Facebook, mostra che gli aggiornamenti politici non sono così diffusi come potrebbero suggerire gli elenchi di Roose.

Ma poi di nuovo, questo tipo di elenco dimostra il punto di Roose: di tutte le prime 10 pagine della settimana precedente, in base alla portata degli utenti attivi negli Stati Uniti, le due pagine politiche con la maggior presenza sono:

- Donald J. Trump

- Fox News

Quindi, mentre le persone vedono molti altri contenuti, potresti anche sostenere che i video delle ricette probabilmente non influenzeranno il modo in cui le persone votano. Il che suggerirebbe che Facebook, anche con la sua stessa spiegazione, sta aiutando a rafforzare opinioni politiche più estreme.

E questo porta poi alla prossima preoccupazione.

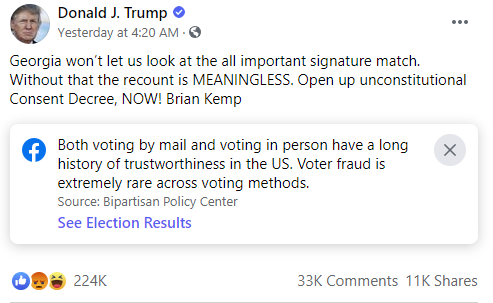

Questa settimana, BuzzFeed News ha riferito che, nonostante Facebook abbia aggiunto etichette di avvertimento ai post di Trump che hanno criticato le elezioni statunitensi e suggerito una frode diffusa nel processo di voto, quelle etichette hanno avuto un impatto minimo sulla condivisione sociale.

BuzzFeed ha condiviso questa citazione da un forum di discussione interno di Facebook:

"Abbiamo prove che l'applicazione di queste [etichette] ai post riduce le loro ricondivisioni dell'8%. Tuttavia, dato che Trump ha così tante azioni su un dato post, la diminuzione non cambierà le azioni di ordini di grandezza.

Come puoi vedere, il post di cui sopra è stato ancora ampiamente condiviso e commentato. Ma Facebook potrebbe anche contribuire direttamente a questo. Come notato, l'algoritmo di Facebook cerca di aumentare i post che vedono un maggiore coinvolgimento, al fine di mantenere le persone attive e sulla piattaforma più a lungo. Ciò significa che i post che generano molti commenti e discussioni tendono a ottenere una copertura maggiore.

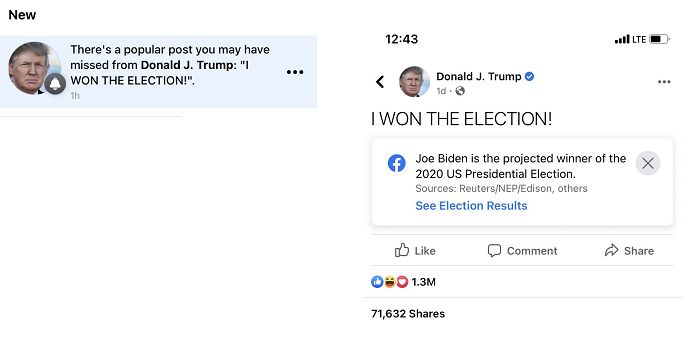

Il sistema di Facebook lo spinge anche direttamente, come mostrato in questo esempio condiviso da Deepa Seetharaman del Wall Street Journal :

Quindi, invece di limitare la diffusione di queste affermazioni, Facebook le sta promuovendo attivamente agli utenti, al fine di stimolare il coinvolgimento. Ciò è in netto contrasto con Twitter, che la scorsa settimana ha riferito di aver visto una diminuzione del 29% dei Tweet di citazione a causa delle proprie etichette di avviso.

I dati qui mostrano che Facebook non solo non sta vedendo alcun impatto importante come risultato delle sue misure di deterrenza, ma che i suoi stessi sistemi, intenzionalmente o meno, stanno persino contrastando tali sforzi.

Come mai? Perché, come molti hanno notato, nella maggior parte dei casi Facebook dà valore al coinvolgimento sopra ogni altra cosa. Sembra, in questo caso, che le sue misure interne per aumentare l'interazione possano inavvertitamente andare contro le sue altre operazioni.

Allora cosa viene dopo? Facebook dovrebbe essere sottoposto a un maggiore controllo ed essere costretto a rivedere i suoi processi per fermare la diffusione della disinformazione?

Questo, almeno in parte, è l'argomento dell'ultima tornata dell'ultima udienza della magistratura del Senato sulle possibili riforme della sezione 230 della legge. Nel contesto di questo esame, Facebook e Twitter hanno affrontato domande sull'influenza delle loro piattaforme e su come i loro sistemi incentivino il coinvolgimento.

Quelle audizioni potrebbero alla fine portare a una riforma, in un modo o nell'altro, e con l'ex presidente Barack Obama questa settimana che suggerisce che le piattaforme sociali dovrebbero affrontare la regolamentazione, potrebbe esserci più movimento in arrivo su questo fronte.

Come ha spiegato Obama a The Atlantic:

" Non ritengo le società tecnologiche interamente responsabili [per l'ascesa della politica populista], perché questo è antecedente ai social media. C'era già. Ma i social media lo hanno potenziato. Conosco la maggior parte di queste persone. Ho parlato con La misura in cui queste società insistono sul fatto di essere più simili a una compagnia telefonica che a The Atlantic , non credo sia sostenibile. Stanno facendo scelte editoriali, che le abbiano seppellite negli algoritmi o meno Il Primo Emendamento non richiede alle società private di fornire una piattaforma per qualsiasi punto di vista che è là fuori.

Con l'ex vicepresidente di Obama, Joe Biden, che prenderà il potere a gennaio, potremmo assistere a un cambiamento significativo nell'approccio a tale progresso, che potrebbe limitare la capacità di Facebook di facilitare tali contenuti.

Ma poi di nuovo, anche se verranno emanate nuove regole, ci saranno sempre casi limite e, come abbiamo visto con l'improvvisa ascesa di Parler, ci saranno anche piattaforme alternative che soddisferanno le opinioni più controverse.

Forse, quindi, questa è una conseguenza di un panorama mediatico più aperto: con meno guardiani per limitare la diffusione della disinformazione, rimarrà sempre più difficile da contenere.

I sostenitori della libertà di parola lo accolgono come un vantaggio, mentre altri potrebbero non esserne così sicuri. Ad ogni modo, con la discussione sulle elezioni del 2020 ancora in corso, è probabile che vedremo altri esempi prima che le piattaforme siano veramente spinte ad agire.