A pesar de todo, Facebook sigue siendo un destacado facilitador de la desinformación electoral

Publicado: 2022-04-08En los últimos cuatro años, Facebook ha implementado una serie de medidas para acabar con la información errónea, abordar la interferencia electoral y garantizar que sus usuarios estén informados con precisión, a pesar de los esfuerzos de varios grupos para utilizar la red masiva de la empresa con el fin de influir en el público. opinar y influir en los resultados electorales a su favor.

El mayor impulso de Facebook se produjo después de las revelaciones de varias operaciones masivas de desinformación e influencia durante la campaña electoral estadounidense de 2016, que incluyeron el escándalo de alto perfil de Cambridge Analytica y las revelaciones de que la Agencia de Investigación de Internet de Rusia publicó miles de anuncios para generar división entre los votantes estadounidenses. Es imposible decir qué tan efectivos fueron estos impulsos, pero ambos ocurrieron, y te imaginas que tuvieron al menos algún efecto.

Las diversas medidas de Facebook parecen haber negado gran parte de la influencia y la manipulación extranjeras que estuvieron presentes en 2016; sin embargo, a pesar de esto, varias ideas nuevas muestran que Facebook todavía está facilitando la difusión de información errónea, con las afirmaciones de fraude electoral del presidente Donald Trump, en particular. , ganando mayor tracción a través de The Social Network.

La semana pasada, Facebook publicó una publicación en la que buscaba refutar las afirmaciones de que su algoritmo amplifica de manera desproporcionada el contenido controvertido de derecha, lo que genera compromiso e interacción y, por lo tanto, aparentemente gana alcance.

Facebook publicó la publicación en respuesta a estas listas, publicadas diariamente por el escritor del New York Times, Kevin Roose.

Las publicaciones de enlaces de mayor rendimiento de las páginas de Facebook de EE. UU. en las últimas 24 horas son de:

– Los 10 principales de Facebook (@FacebooksTop10) 17 de noviembre de 2020

1. Dan Bongino

2. ZORRO 29

3. Donald J. Trump

4. Donald J. Trump

5. Noticias Fox

6. Dan Bongino

7. CNN

8. Dios Es Bueno

9. Breitbart

10. Noticias del zorro

Las listas, que se basan en los datos de participación a los que se accede a través de la propia plataforma de análisis de Facebook, CrowdTangle, parecen mostrar que el contenido de los editores de extrema derecha funciona mejor en Facebook, lo que a menudo significa que la información cuestionable, si no demostrablemente falsa, está teniendo un gran alcance y compromiso a través de la red social.

Pero espera, dijo Facebook, esa no es toda la historia:

" La mayoría del contenido que la gente ve [en Facebook], incluso en una temporada electoral, no se trata de política. De hecho, según nuestro análisis, el contenido político representa aproximadamente el 6% de lo que ve en Facebook. Esto incluye publicaciones de amigos. o de páginas (que son perfiles públicos creados por empresas, marcas, celebridades, medios de comunicación, causas y similares)".

Entonces, si bien las cifras publicadas por Roose pueden mostrar que el contenido de noticias de derecha genera mucha participación, eso es solo una fracción de lo que los usuarios ven en general.

" Clasificar las publicaciones principales de la página por reacciones, comentarios, etc. no muestra una imagen completa de lo que la gente realmente ve en Facebook".

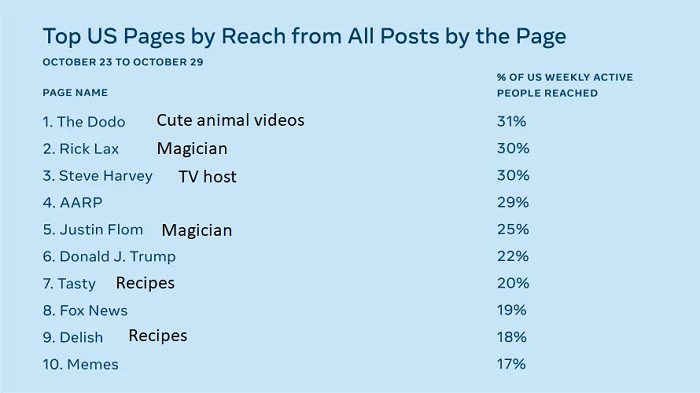

Para demostrar esto, Facebook compartió esta lista de qué contenido realmente tiene el mayor alcance en Facebook, es decir, las publicaciones de estas páginas aparecieron en la sección de noticias de la mayoría de los usuarios durante la semana en cuestión:

Agregué las descripciones de texto negro para el contexto. Como puede ver, la mayoría del contenido que la gente ve no tiene una base política, lo que, según Facebook, muestra que las actualizaciones políticas no son tan frecuentes como sugieren las listas de Roose.

Pero, de nuevo, esta lista prueba el punto de Roose: de todas las 10 páginas principales de la semana anterior, según el alcance a los usuarios activos de EE. UU., las dos páginas políticas con mayor presencia son:

- Donald J. Trump

- Fox News

Entonces, si bien las personas ven muchos otros contenidos, también podría argumentar que los videos de recetas probablemente no influirán en cómo vota la gente. Lo que sugeriría que Facebook, incluso por su propia explicación, está ayudando a impulsar puntos de vista políticos más extremos.

Y eso lleva a la siguiente preocupación.

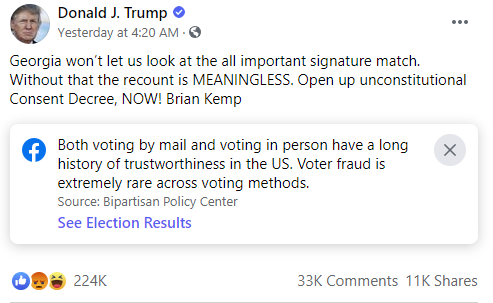

Esta semana, BuzzFeed News informó que, a pesar de que Facebook agregó etiquetas de advertencia a las publicaciones de Trump que criticaron las elecciones estadounidenses y sugirieron un fraude generalizado en el proceso de votación, esas etiquetas tuvieron poco impacto en las redes sociales.

BuzzFeed compartió esta cita de un foro de discusión interno de Facebook:

”Tenemos evidencia de que aplicar estas [etiquetas] a las publicaciones reduce sus compartidos en ~8%. Sin embargo, dado que Trump tiene TANTAS acciones en cualquier publicación, la disminución no va a cambiar las acciones en órdenes de magnitud”.

Como puede ver, la publicación anterior todavía fue ampliamente compartida y comentada. Pero Facebook también puede estar contribuyendo directamente a eso. Como se señaló, el algoritmo de Facebook busca impulsar las publicaciones que tienen más participación, para mantener a las personas activas y en la plataforma por más tiempo. Eso significa que las publicaciones que generan muchos comentarios y discusiones tienden a tener un mayor alcance.

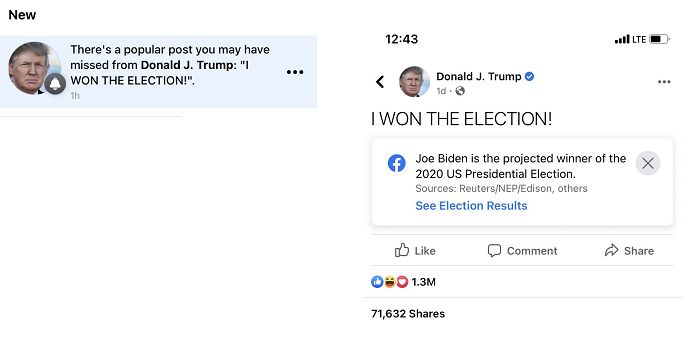

El sistema de Facebook incluso impulsa eso directamente, como se muestra en este ejemplo compartido por Deepa Seetharaman de The Wall Street Journal :

Entonces, en lugar de limitar la difusión de estas afirmaciones, Facebook las promociona activamente entre los usuarios para generar participación. Eso contrasta significativamente con Twitter, que la semana pasada informó que había visto una disminución del 29% en los tuits de citas como resultado de sus propias etiquetas de advertencia.

Los datos aquí muestran que Facebook no solo no está viendo ningún impacto importante como resultado de sus medidas de disuasión, sino que sus propios sistemas, intencionalmente o no, incluso están contrarrestando tales esfuerzos.

¿Por qué? Porque como muchos han notado, Facebook valora el compromiso por encima de todo en la mayoría de los casos. Parece, en este caso, que sus medidas internas para impulsar la interacción pueden estar yendo inadvertidamente en contra de sus otras operaciones.

Entonces, ¿qué viene después? ¿Debe Facebook someterse a un mayor escrutinio y verse obligado a revisar sus procesos para detener la propagación de información errónea?

Ese, al menos en parte, es el tema de la última ronda de la última Audiencia Judicial del Senado sobre posibles reformas a las leyes de la Sección 230. En el contexto de este examen, Facebook y Twitter se han enfrentado a preguntas sobre la influencia de sus plataformas y cómo sus sistemas incentivan la participación.

Esas audiencias podrían eventualmente conducir a una reforma, de una forma u otra, y con el expresidente Barack Obama esta semana sugiriendo que las plataformas sociales deberían enfrentar la regulación, podría haber más movimiento en este frente.

Como explicó Obama a The Atlantic:

" No responsabilizo por completo a las empresas de tecnología [por el auge de la política populista], porque esto es anterior a las redes sociales. Ya estaba allí. Pero las redes sociales lo han potenciado. Conozco a la mayoría de estas personas. He hablado con no creo que sea sostenible. Están tomando decisiones editoriales, ya sea que las hayan enterrado en algoritmos o no . La Primera Enmienda no requiere que las empresas privadas proporcionen una plataforma para cualquier punto de vista que exista”.

Con el ex vicepresidente de Obama, Joe Biden, listo para tomar las riendas en enero, podríamos ver un cambio significativo en el enfoque para avanzar, lo que podría limitar la capacidad de Facebook para facilitar dicho contenido.

Pero, de nuevo, incluso si se promulgan nuevas reglas, siempre habrá casos límite y, como hemos visto con el ascenso repentino de Parler, también habrá plataformas alternativas que se adaptarán a puntos de vista más controvertidos.

Tal vez, entonces, esto sea una consecuencia de un panorama de medios más abierto: con menos guardianes para limitar la difusión de información errónea, seguirá siendo cada vez más difícil de contener.

Los defensores de la libertad de expresión saludarán esto como un beneficio, mientras que otros pueden no estar tan seguros. De cualquier manera, con la discusión de las elecciones de 2020 aún en desarrollo, es probable que veamos más ejemplos de esto antes de que las plataformas realmente se vean obligadas a actuar.