Trotz allem bleibt Facebook ein prominenter Vermittler von Fehlinformationen bei Wahlen

Veröffentlicht: 2022-04-08In den letzten vier Jahren hat Facebook eine Reihe von Maßnahmen ergriffen, um Fehlinformationen auszurotten, Wahlstörungen zu bekämpfen und sicherzustellen, dass seine Nutzer trotz verschiedener Bemühungen verschiedener Gruppen, das riesige Netzwerk des Unternehmens zu nutzen, um die Öffentlichkeit zu beeinflussen, genau informiert werden Meinung und beeinflussen Wahlergebnisse zu ihren Gunsten.

Der verstärkte Vorstoß von Facebook erfolgte nach Enthüllungen über verschiedene Massen-Fehlinformationen und Beeinflussungsoperationen während des US-Wahlkampfs 2016, zu denen der hochkarätige Cambridge-Analytica-Skandal und die Enthüllungen der russischen Internetforschungsagentur gehörten, die Tausende von Anzeigen schaltete, um die Spaltung unter den US-Wählern auszulösen. Wie effektiv einer dieser Vorstöße tatsächlich war, ist unmöglich zu sagen, aber beide sind passiert, und Sie können sich vorstellen, dass sie zumindest eine gewisse Wirkung hatten.

Die verschiedenen Maßnahmen von Facebook scheinen einen Großteil des ausländischen Einflusses und der Manipulation, die 2016 vorhanden waren, zunichte gemacht zu haben – dennoch zeigen mehrere neue Erkenntnisse, dass Facebook immer noch die Verbreitung von Fehlinformationen erleichtert, insbesondere mit den Behauptungen von Präsident Donald Trump über Wahlbetrug , und gewinnt über The Social Network zunehmend an Zugkraft.

Letzte Woche veröffentlichte Facebook einen Beitrag, in dem es versuchte, Behauptungen zu widerlegen, dass sein Algorithmus umstrittene rechte Inhalte unverhältnismäßig verstärkt, was zu Engagement und Interaktion führt und daher scheinbar an Reichweite gewinnt.

Facebook veröffentlichte den Post als Antwort auf diese Listen, die täglich vom New York Times-Autor Kevin Roose veröffentlicht wurden.

Die erfolgreichsten Link-Posts von US-Facebook-Seiten in den letzten 24 Stunden stammen von:

– Facebooks Top 10 (@FacebooksTop10) 17. November 2020

1. Dan Bongino

2. FUCHS 29

3. Donald J. Trumpf

4. Donald J. Trumpf

5. Fox-Nachrichten

6. Dan Bongino

7. CNN

8. Dios Es Bueno

9. Breitbart

10. Fox-News

Die Listen, die auf Interaktionsdaten basieren, die über Facebooks eigene Analyseplattform CrowdTangle abgerufen wurden, scheinen zu zeigen, dass Inhalte von rechtsextremen Publishern auf Facebook besser abschneiden, was oft bedeutet, dass fragwürdige, wenn nicht nachweislich falsche Informationen große Reichweite und Reichweite erhalten Engagement im gesamten sozialen Netzwerk.

Aber Moment mal, sagte Facebook, das ist nicht die ganze Geschichte:

„ Die meisten Inhalte, die die Leute [auf Facebook] sehen, selbst in einer Wahlsaison, handeln nicht von Politik. Tatsächlich machen politische Inhalte unserer Analyse zufolge etwa 6 % dessen aus, was Sie auf Facebook sehen. Dazu gehören Beiträge von Freunden oder von Seiten (das sind öffentliche Profile, die von Unternehmen, Marken, Prominenten, Medien, Organisationen und dergleichen erstellt wurden)."

Während die von Roose veröffentlichten Zahlen zeigen mögen, dass rechte Nachrichteninhalte viel Engagement erhalten, ist dies nur ein Bruchteil dessen, was die Benutzer insgesamt sehen.

„ Die Rangfolge der Top-Page-Beiträge nach Reaktionen, Kommentaren usw. zeichnet kein vollständiges Bild dessen, was die Leute tatsächlich auf Facebook sehen. “

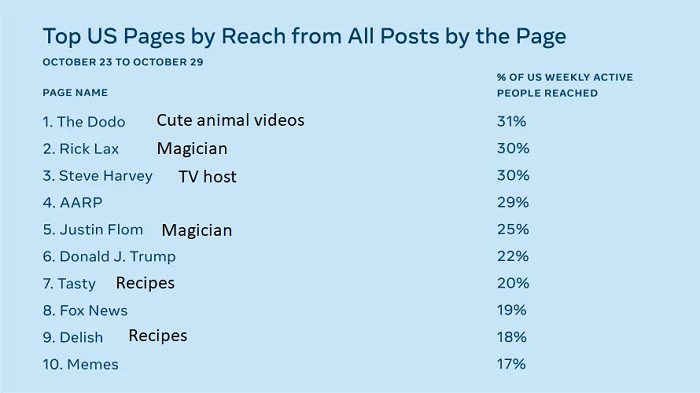

Um dies zu demonstrieren, hat Facebook diese Auflistung geteilt, welche Inhalte tatsächlich die größte Reichweite auf Facebook haben – dh Beiträge von diesen Seiten erschienen in der betreffenden Woche im Newsfeed mit den meisten Benutzern:

Ich habe die schwarzen Textbeschreibungen für den Kontext hinzugefügt. Wie Sie sehen können, sind die meisten Inhalte, die die Leute sehen, nicht politisch, was laut Facebook zeigt, dass politische Updates nicht so weit verbreitet sind, wie Rooses Einträge vermuten lassen.

Aber andererseits beweist diese Auflistung irgendwie Rooses Standpunkt – von allen Top-10-Seiten der obigen Woche, basierend auf der Reichweite aktiver US-Nutzer, sind die beiden politischen Seiten mit der größten Präsenz:

- Donald J. Trumpf

- Fox News

Während die Leute also viele andere Inhalte sehen, könnte man genauso argumentieren, dass Rezeptvideos wahrscheinlich keinen Einfluss darauf haben werden, wie die Leute abstimmen. Was darauf hindeuten würde, dass Facebook, selbst nach eigener Erklärung, dazu beiträgt, extremere politische Ansichten zu fördern.

Und das führt dann zum nächsten Anliegen.

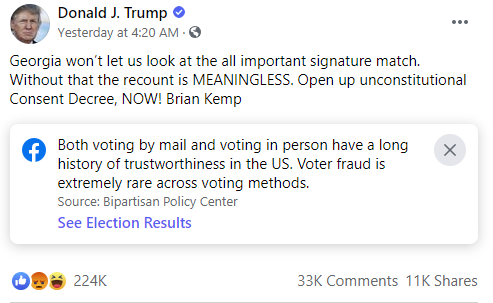

Diese Woche hat BuzzFeed News berichtet, dass, obwohl Facebook Warnhinweise zu Trumps Posts hinzugefügt hat, die die US-Wahlen kritisierten und auf weit verbreiteten Betrug im Wahlprozess hindeuteten, diese Etiketten wenig Einfluss auf das Teilen in sozialen Netzwerken hatten.

BuzzFeed teilte dieses Zitat aus einem internen Facebook-Diskussionsforum:

„Wir haben Beweise dafür, dass das Anwenden dieser [Labels] auf Posts ihre erneute Freigabe um ~8 % verringert. Angesichts der Tatsache, dass Trump SO viele Aktien auf einem bestimmten Posten hat, wird der Rückgang die Aktien nicht um Größenordnungen verändern.“

Wie Sie sehen können, wurde der obige Beitrag immer noch weit verbreitet und kommentiert. Aber Facebook kann auch direkt dazu beitragen. Wie bereits erwähnt, versucht der Algorithmus von Facebook, Beiträge mit mehr Engagement zu fördern, um die Menschen länger aktiv und auf der Plattform zu halten. Das bedeutet, dass Posts, die viele Kommentare und Diskussionen generieren, tendenziell eine höhere Reichweite erzielen.

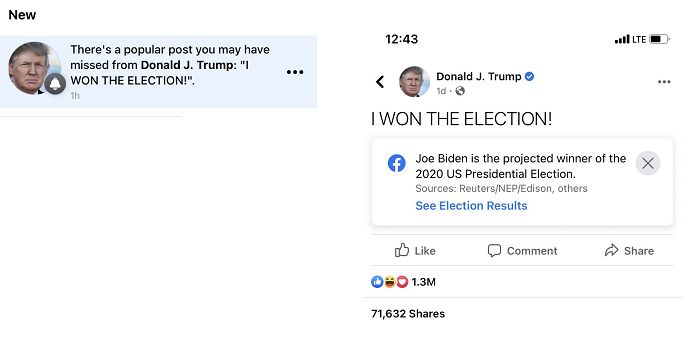

Das System von Facebook treibt das sogar direkt voran – wie in diesem Beispiel gezeigt, das von Deepa Seetharaman vom Wall Street Journal geteilt wird :

Anstatt also die Verbreitung dieser Behauptungen einzuschränken, bewirbt Facebook sie aktiv bei den Nutzern, um das Engagement zu wecken. Das steht in deutlichem Gegensatz zu Twitter, das letzte Woche berichtete, dass es aufgrund seiner eigenen Warnhinweise einen Rückgang der Zitat-Tweets um 29 % verzeichnet habe.

Die Daten hier zeigen, dass Facebook nicht nur keine großen Auswirkungen seiner Abschreckungsmaßnahmen sieht, sondern dass seine eigenen Systeme, gewollt oder ungewollt, solchen Bemühungen sogar entgegenwirken.

Wieso den? Denn wie viele angemerkt haben, schätzt Facebook Engagement in den meisten Fällen über alles. Es scheint, dass in diesem Fall seine internen Maßnahmen zur Förderung der Interaktion versehentlich gegen seine anderen Operationen verstoßen.

Was kommt als nächstes? Sollte Facebook genauer unter die Lupe genommen und gezwungen werden, seine Prozesse zu überprüfen, um die Verbreitung von Fehlinformationen zu stoppen?

Das ist zumindest teilweise das Thema der jüngsten Runde der jüngsten Justizanhörung des Senats zu möglichen Reformen der § 230-Gesetze. Im Rahmen dieser Untersuchung wurden Facebook und Twitter mit Fragen zum Einfluss ihrer Plattformen und dazu konfrontiert, wie ihre Systeme Engagement anregen.

Diese Anhörungen könnten schließlich auf die eine oder andere Weise zu Reformen führen, und da der frühere Präsident Barack Obama diese Woche vorschlug, dass soziale Plattformen einer Regulierung unterzogen werden sollten, könnte an dieser Front mehr Bewegung kommen.

Wie Obama gegenüber The Atlantic erklärte:

„ Ich mache die Technologieunternehmen nicht vollständig verantwortlich [für den Aufstieg populistischer Politik], weil dies vor den sozialen Medien existierte. Es war bereits da. Aber die sozialen Medien haben es aufgeladen. Ich kenne die meisten dieser Leute. Ich habe mit ihnen gesprochen Das Ausmaß, in dem diese Unternehmen darauf bestehen, dass sie eher wie eine Telefongesellschaft als wie The Atlantic sind, halte ich für nicht haltbar. Sie treffen redaktionelle Entscheidungen, ob sie sie in Algorithmen begraben haben oder nicht Der First Amendment verlangt von privaten Unternehmen nicht, dass sie eine Plattform für irgendwelche Ansichten bieten, die da draußen sind.“

Da Obamas ehemaliger Vizepräsident Joe Biden im Januar die Regierungsgeschäfte übernehmen wird, könnten wir eine deutliche Verschiebung in der Herangehensweise an solche Fortschritte sehen, was die Fähigkeit von Facebook einschränken könnte, solche Inhalte zu ermöglichen.

Aber selbst wenn neue Regeln erlassen werden, wird es immer Grenzfälle geben, und wie wir beim plötzlichen Aufstieg von Parler gesehen haben, wird es auch alternative Plattformen geben, die kontroverseren Ansichten gerecht werden.

Vielleicht ist dies eine Folge einer offeneren Medienlandschaft – mit weniger Gatekeepern zur Begrenzung der Verbreitung von Fehlinformationen wird es immer schwieriger, sie einzudämmen.

Befürworter der Meinungsfreiheit werden dies als Vorteil begrüßen, während andere sich vielleicht nicht so sicher sind. Wie auch immer, da die Wahldiskussion 2020 noch im Gange ist, werden wir wahrscheinlich weitere Beispiele dafür sehen, bevor die Plattformen wirklich zum Handeln gedrängt werden.