Mimo wszystko Facebook pozostaje wybitnym pośrednikiem dezinformacji wyborczej

Opublikowany: 2022-04-08W ciągu ostatnich czterech lat Facebook wdrożył szereg środków w celu wyeliminowania dezinformacji, przeciwdziałania ingerencji w wybory i zapewnienia, że jego użytkownicy są dokładnie informowani, pomimo różnych wysiłków podejmowanych przez różne grupy, w celu wykorzystania ogromnej sieci firmy w celu wywierania wpływu na opinię publiczną. opinia i wpływ wyborów na ich korzyść.

Zwiększony nacisk Facebooka nastąpił po ujawnieniu różnych masowych dezinformacji i operacji wywierania wpływu podczas kampanii wyborczej w USA w 2016 r., która obejmowała głośny skandal z Cambridge Analytica oraz doniesienia o rosyjskiej Agencji Badań Internetowych, która wyświetlała tysiące reklam, aby wywołać podziały wśród amerykańskich wyborców. Nie można powiedzieć, jak skuteczne było którekolwiek z tych pchnięć, ale oba się wydarzyły i można sobie wyobrazić, że przyniosły one przynajmniej pewien efekt.

Wydaje się, że różne środki Facebooka zneutralizowały wiele zagranicznych wpływów i manipulacji, które miały miejsce w 2016 r. – a mimo to kilka nowych spostrzeżeń pokazuje, że Facebook nadal ułatwia rozpowszechnianie dezinformacji, w szczególności twierdzenia prezydenta Donalda Trumpa o oszustwach wyborczych , zyskując większą atrakcyjność za pośrednictwem sieci społecznościowej.

W zeszłym tygodniu Facebook opublikował post, w którym starał się obalić twierdzenia, że jego algorytm nieproporcjonalnie wzmacnia kontrowersyjne prawicowe treści, które pobudzają zaangażowanie i interakcję, a zatem pozornie zyskują zasięg.

Facebook opublikował post w odpowiedzi na te listy, publikowane codziennie przez pisarza New York Times, Kevina Roose.

Najskuteczniejsze posty z linkami na amerykańskich stronach Facebooka w ciągu ostatnich 24 godzin pochodzą z:

— Top 10 Facebooka (@FacebooksTop10) 17 listopada 2020 r.

1. Dan Bongino

2. LIS 29

3. Donald J. Trump

4. Donald J. Trump

5. Fox News

6. Dan Bongino

7. CNN

8. Dios Es Bueno

9. Breitbart

10. Lisowe wiadomości

Listy, które są oparte na danych o zaangażowaniu, do których uzyskano dostęp za pośrednictwem własnej platformy analitycznej Facebooka CrowdTangle, wydają się pokazywać, że treści od skrajnie prawicowych wydawców działają lepiej na Facebooku, co często oznacza, że wątpliwe, jeśli nie w oczywisty sposób fałszywe informacje, zyskują duży zasięg i zaangażowanie w sieci społecznościowej.

Ale poczekaj, powiedział Facebook, to nie jest cała historia:

Większość treści, które ludzie widzą [na Facebooku], nawet w sezonie wyborczym, nie dotyczy polityki. W rzeczywistości, na podstawie naszej analizy, treści polityczne stanowią około 6% tego, co widzisz na Facebooku. Obejmuje to posty od znajomych lub ze Stron (które są profilami publicznymi utworzonymi przez firmy, marki, celebrytów, media, cele i tym podobne)."

Więc chociaż liczby opublikowane przez Roose'a mogą wskazywać, że prawicowe treści informacyjne są bardzo zaangażowane, to tylko ułamek tego, co ogólnie widzą użytkownicy.

" Ranking najlepszych postów na stronie według reakcji, komentarzy itp. nie oddaje pełnego obrazu tego, co ludzie faktycznie widzą na Facebooku. "

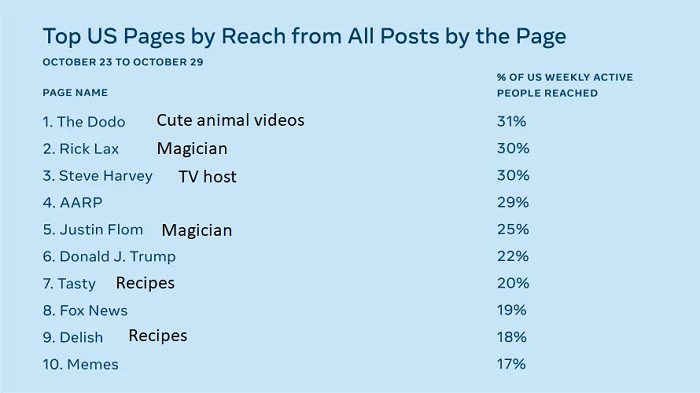

Aby to zademonstrować, Facebook udostępnił tę listę treści, które faktycznie mają największy zasięg na Facebooku – tj. posty z tych stron pojawiały się w najczęściej używanym kanale aktualności w danym tygodniu:

Dodałem czarne opisy tekstowe dla kontekstu. Jak widać, większość treści, które ludzie widzą, nie ma charakteru politycznego, co, jak twierdzi Facebook, pokazuje, że aktualizacje polityczne nie są tak rozpowszechnione, jak mogą sugerować aukcje Roose'a.

Ale z drugiej strony, ten wpis dowodzi słuszności Roose'a - ze wszystkich 10 najlepszych stron z poprzedniego tygodnia, w oparciu o zasięg do aktywnych użytkowników w USA, dwie strony polityczne z największą obecnością to:

- Donald J. Trump

- Fox News

Więc chociaż ludzie widzą wiele innych treści, możesz równie dobrze argumentować, że filmy z przepisami prawdopodobnie nie wpłyną na to, jak ludzie głosują. Co sugerowałoby, że Facebook, nawet własnym wyjaśnieniem, pomaga w promowaniu bardziej ekstremalnych poglądów politycznych.

A to prowadzi do kolejnego zmartwienia.

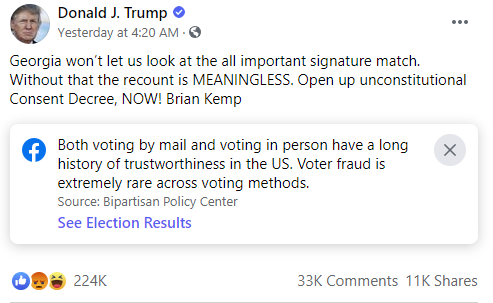

W tym tygodniu BuzzFeed News poinformował, że pomimo dodania przez Facebooka etykiet ostrzegawczych do postów Trumpa, które krytykowały amerykańskie wybory i sugerowały powszechne oszustwa w procesie głosowania, te etykiety miały niewielki wpływ na udostępnianie społecznościowe.

BuzzFeed udostępnił ten cytat z wewnętrznego forum dyskusyjnego na Facebooku:

„Mamy dowody na to, że nałożenie tych [etykiet] na posty zmniejsza ich ponowne udostępnianie o ~8%. Jednak biorąc pod uwagę, że Trump ma tak wiele akcji w danym poście, spadek nie zmieni akcji o rzędy wielkości.

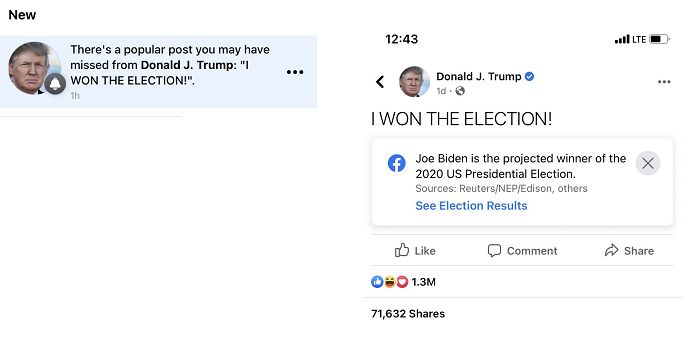

Jak widać, powyższy post był nadal szeroko udostępniany i komentowany. Ale Facebook może również bezpośrednio się do tego przyczyniać. Jak już wspomniano, algorytm Facebooka ma na celu zwiększenie liczby postów, które generują większe zaangażowanie, aby ludzie dłużej byli aktywni i na platformie. Oznacza to, że posty, które generują dużo komentarzy i dyskusji, mają zwykle większy zasięg.

System Facebooka wręcz to popycha – jak pokazuje przykład udostępniony przez Deepę Seetharaman z The Wall Street Journal :

Dlatego zamiast ograniczać rozpowszechnianie tych twierdzeń, Facebook aktywnie promuje je wśród użytkowników, aby wzbudzić zaangażowanie. Stanowi to znaczny kontrast z Twitterem, który w zeszłym tygodniu poinformował, że odnotował 29% spadek liczby tweetów z cytatami w wyniku własnych etykiet ostrzegawczych.

Dane tutaj pokazują, że Facebook nie tylko nie widzi żadnego większego wpływu w wyniku swoich środków odstraszających, ale że jego własne systemy, celowo lub nie, nawet przeciwdziałają takim wysiłkom.

Czemu? Ponieważ, jak wielu zauważyło, w większości przypadków Facebook ceni zaangażowanie ponad wszystko. Wydaje się, że w tym przypadku jej wewnętrzne środki mające na celu zwiększenie interakcji mogą nieumyślnie sprzeciwiać się innym jej działaniom.

Więc co będzie dalej? Czy Facebook powinien zostać dokładniej zbadany i zmuszony do przeglądu swoich procesów w celu powstrzymania rozprzestrzeniania się dezinformacji?

To, przynajmniej częściowo, jest tematem ostatniej rundy ostatniego przesłuchania sądowego w Senacie w sprawie możliwych reform ustaw Sekcji 230. W kontekście tego badania Facebook i Twitter zmierzyły się z pytaniami o wpływ ich platform oraz o to, w jaki sposób ich systemy zachęcają do zaangażowania.

Te przesłuchania mogą ostatecznie doprowadzić do reform, w taki czy inny sposób, a ponieważ były prezydent Barack Obama w tym tygodniu zasugerował, że platformy społecznościowe powinny stanąć w obliczu regulacji, może pojawić się więcej ruchów na tym froncie.

Jak wyjaśnił Obama The Atlantic:

„ Nie uważam, że firmy technologiczne są całkowicie odpowiedzialne [za wzrost populistycznej polityki], ponieważ to poprzedza media społecznościowe. To już tam było. Ale media społecznościowe to turbodoładowały. Znam większość tych ludzi. Rozmawiałem z im o tym. Stopień, w jakim te firmy upierają się, że bardziej przypominają firmę telekomunikacyjną niż The Atlantic , nie wydaje mi się możliwe do utrzymania. Dokonują wyborów redakcyjnych, niezależnie od tego, czy ukryły je w algorytmach, czy nie. Pierwsza poprawka nie wymaga, aby prywatne firmy zapewniały platformę dla wszelkich poglądów, które tam są”.

Ponieważ były wiceprezes Obamy Joe Biden ma objąć rządy w styczniu, mogliśmy zobaczyć znaczną zmianę podejścia do takich postępów, co może ograniczyć zdolność Facebooka do udostępniania takich treści.

Ale z drugiej strony, nawet jeśli nowe zasady zostaną uchwalone, zawsze będą przypadki graniczne, a jak widzieliśmy wraz z nagłym wzrostem Parlera, będą też alternatywne platformy, które zaspokoją bardziej kontrowersyjne poglądy.

Być może jest to zatem konsekwencja bardziej otwartego krajobrazu medialnego – przy mniejszej liczbie strażników ograniczających rozprzestrzenianie się dezinformacji, będzie to coraz trudniejsze do opanowania.

Zwolennicy wolności słowa uznają to za korzyść, podczas gdy inni mogą nie być tego tak pewni. Tak czy inaczej, przy wciąż toczącej się dyskusji wyborczej w 2020 roku prawdopodobnie zobaczymy więcej takich przykładów, zanim platformy zostaną naprawdę zmuszone do działania.